Qué ha pasado. Cuentan en Futurism que en 2024, la Universidad Católica Australiana acusó a unos 6.000 estudiantes de mala conducta académica. Al menos el 90% de casos estaban relacionados con el uso de IA para hacer trampas. Lo llamativo es que la propia universidad usó una IA para emitir estas acusaciones, muchas de las cuales fueron erróneas.

Por qué es importante. Es un ejemplo más de que la IA aún no es fiable. Lo vemos constantemente con resultados erróneos y alucinaciones. La universidad australiana no es la única que ha confiado en la IA para acusar a sus estudiantes, es una práctica bastante habitual y ha habido otros casos similares. La realidad es que los detectores de textos generados con IA también son IA y, al menos por ahora, son imperfectos.

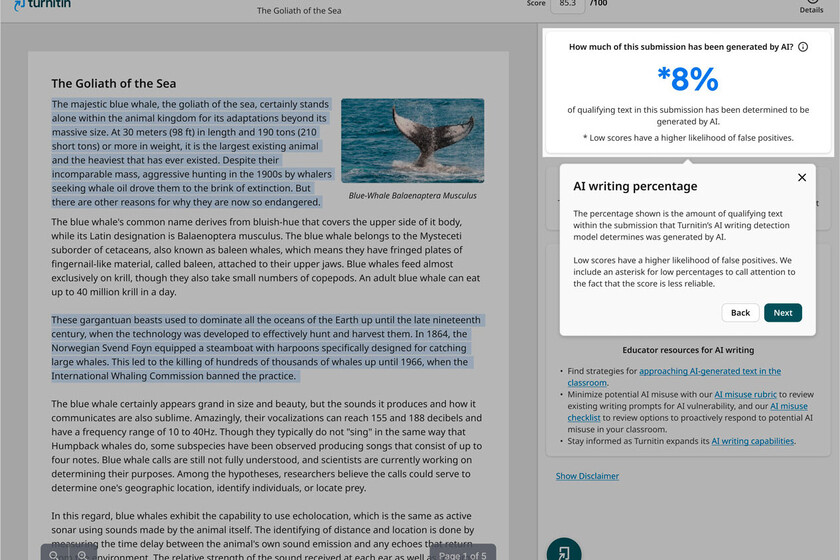

Turnitin. Es un software de detección de plagios cuya primera versión fue lanzada en 1997 y es bastante usado en universidades y centros educativos. En 2023 añadió una herramienta para detectar textos creados con IA y es la que usaron en la Universidad Católica Australiana. La propia empresa dice en su guía de uso que el detector de IA no siempre es preciso y no debe ser usado como única fuente a la hora de acusar a un estudiante. Sin embargo, según ABC Australia, la universidad lo usó como única prueba a la hora de emitir sus expedientes por mala conducta.

La versión de la universidad. Las acusaciones sobre el uso de IA incluían trabajos generados por IA, referencias inventadas (alucinaciones) y el uso de herramientas IA para citar y traducir contenido. La universidad dice que al menos un cuarto de todas las acusaciones se retiraron tras una investigación. También desestimaron aquellas en las que la única prueba era la propia IA y en marzo de este año dejaron de usar ese software.

El dilema. La irrupción de las herramientas IA plantea retos en el sector educativo.Hay voces que abogan por su prohibición, mientras que otras defienden la integración y fomentar buenas prácticas. La UNESCO publicó una guía para el uso de IA generativa en educación en la que establecen unas normas y obligaciones, como la protección de la privacidad, límites de edad y un enfoque que garantice un uso ético y seguro de estas herramientas.

Imagen | Turnitin

En Xataka | Una profesora corrigió un examen final hecho con ChatGPT, pero otra IA lo evaluó distinto y expuso el dilema